今年も国際展示場、ビックサイトでMaker Faire Tokyoが開催された。少し前のBayAreaは足が蜂窩織炎になって、エントリーするも行けず…事前に「また開催直前に足が腐ったらどうしよう」とか思ったけど、大丈夫っした。健康万歳。

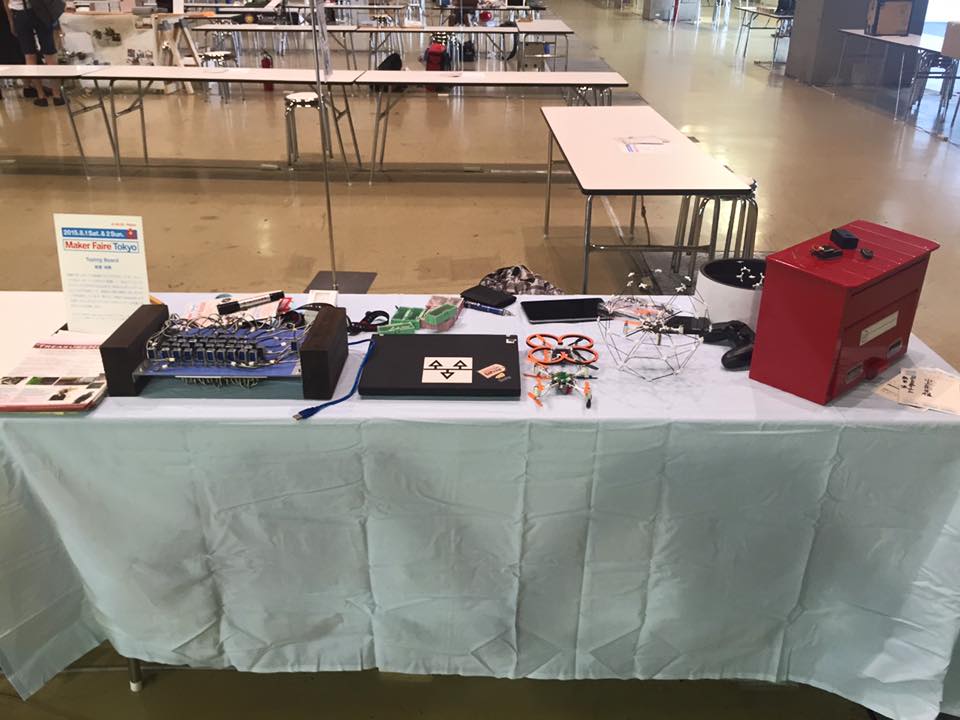

今年の自分の出し物は以下。

Typing Board (一番左のもの)

これはマニア層にウケた。キーボードを叩くともう一方のPCのキーボードを叩くというシンプルな物で、ソレノイドを大量にキーボードの上に並べて叩くという力技的なもの。意味あるの?(ないです。楽しそうだから作っただけ)、技術の無駄使い(褒め言葉ですw)、爆(w)みたいな反応でいい感じ。

ポスト君 (一番右のもの)

これは一般層にウケた。売り物?欲しい、作って、売って!!といった反応。作ります(というかモックは目の前にw)。250枚刷ったチラシが見事に無くなった。

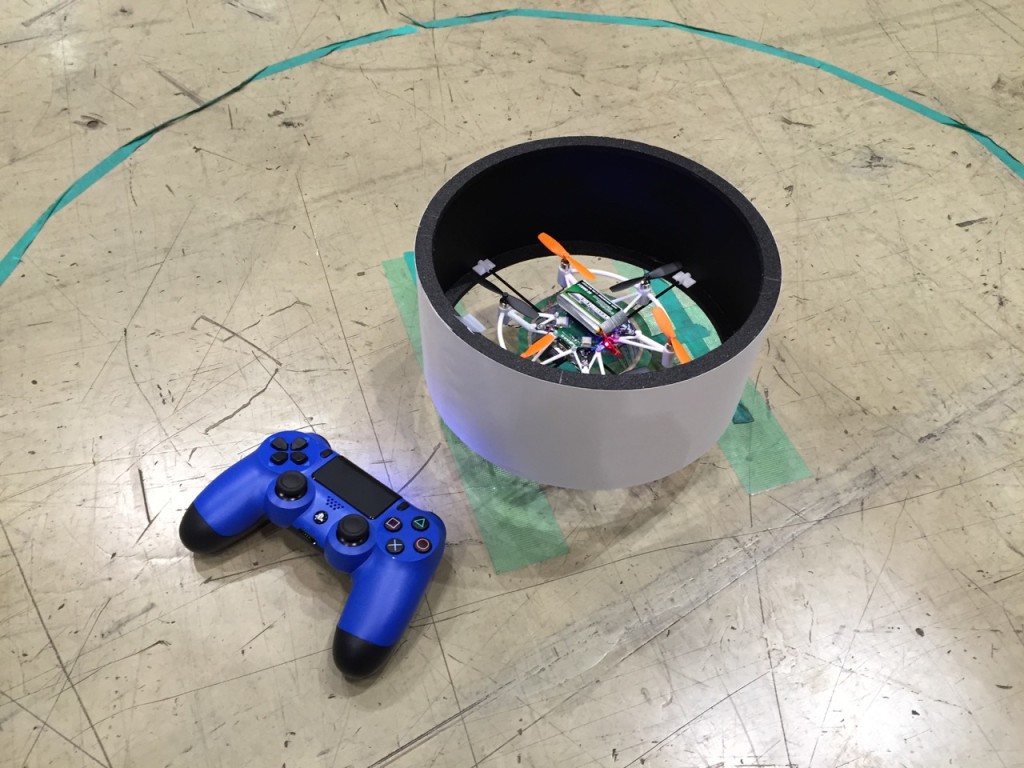

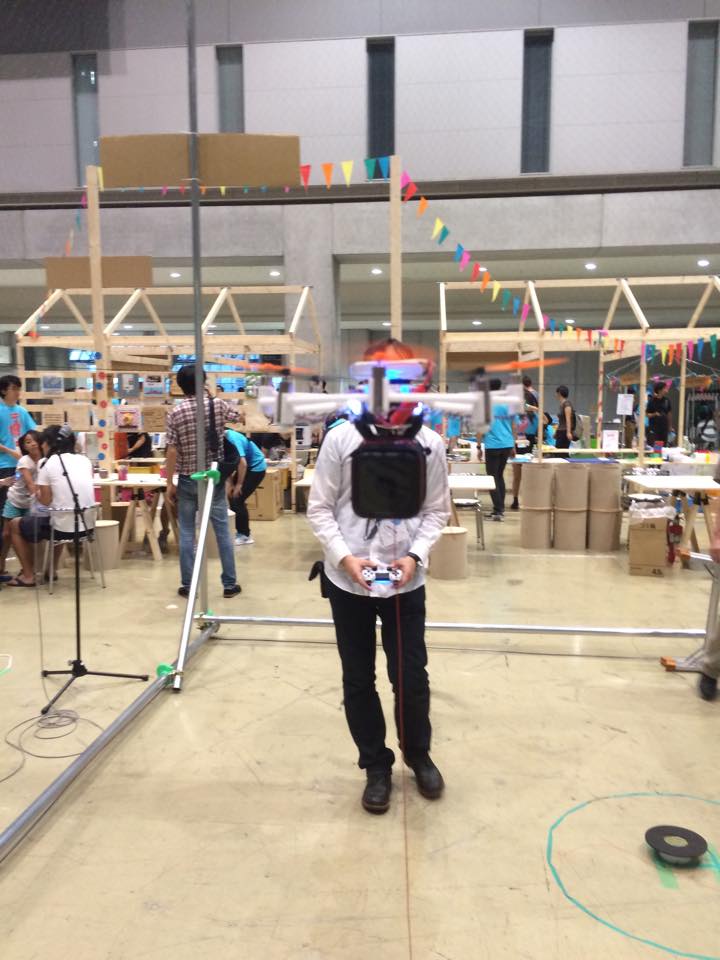

ドローン(真ん中、Androidアプリ、プロジェクタで投影)

多分、全体の8割くらいの時間を事前の準備で当てた。魔法の大鍋さんのドローンをトラッキングしてプロジェクタで光を当てるというもの。

何はともあれ、こんな感じのものです。

こちら湯村さんが撮ってアップして貰えていたものです。

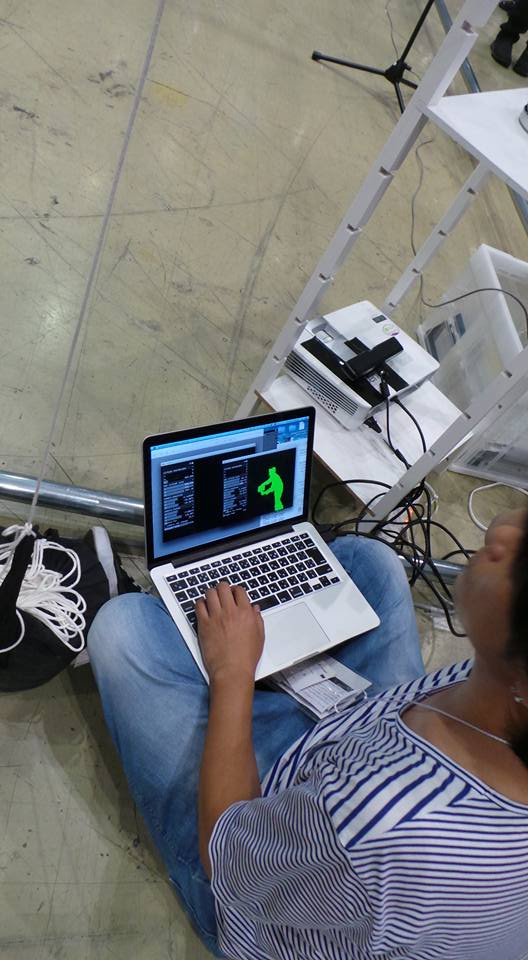

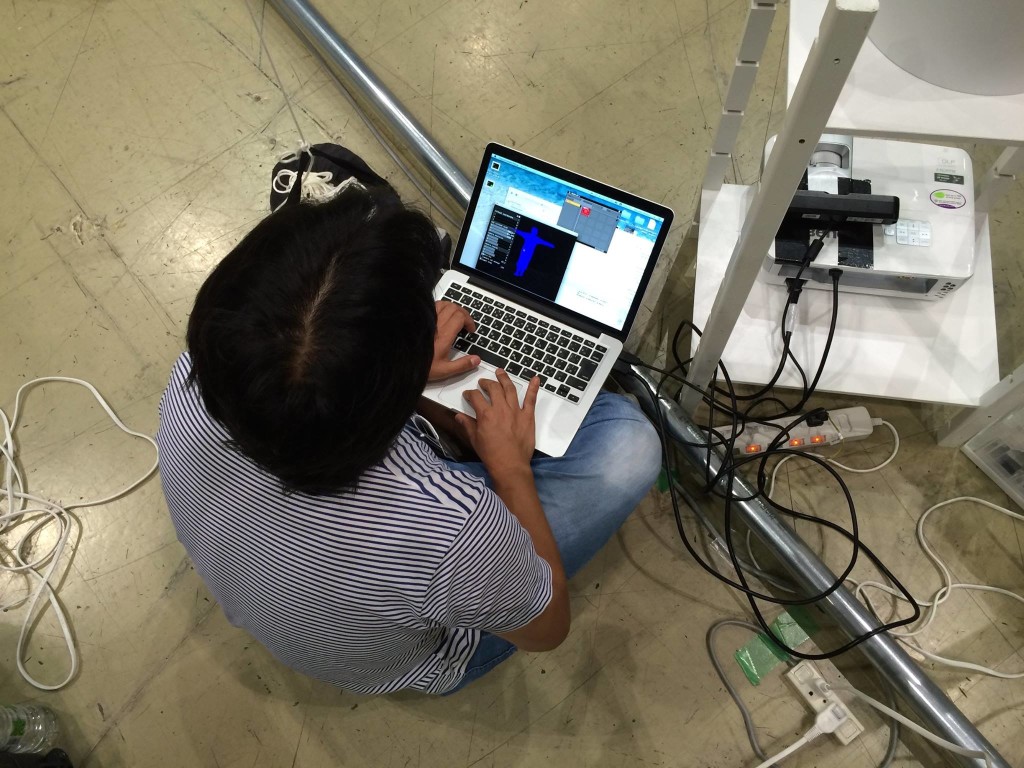

新里さんのDrone Tracking Projectionの捜査風景。

Posted by 伊藤 武仙 on 2015年8月1日

こちらは伊藤さんが撮ってアップして貰えたものです。

以下、写真を撮ってもらった皆さんに感謝です。

このdroneにXtion/プロジェクターを使って投影といった感じ。

使ったアプリはこんな感じ。プログラマブルでよく利用される環境ですね。

PC : Macbook Pro

トラッキング : Xtion(OpenNI2/Depthのみ利用)

ソフト : openFrameworks 0.8.4, VDMX5

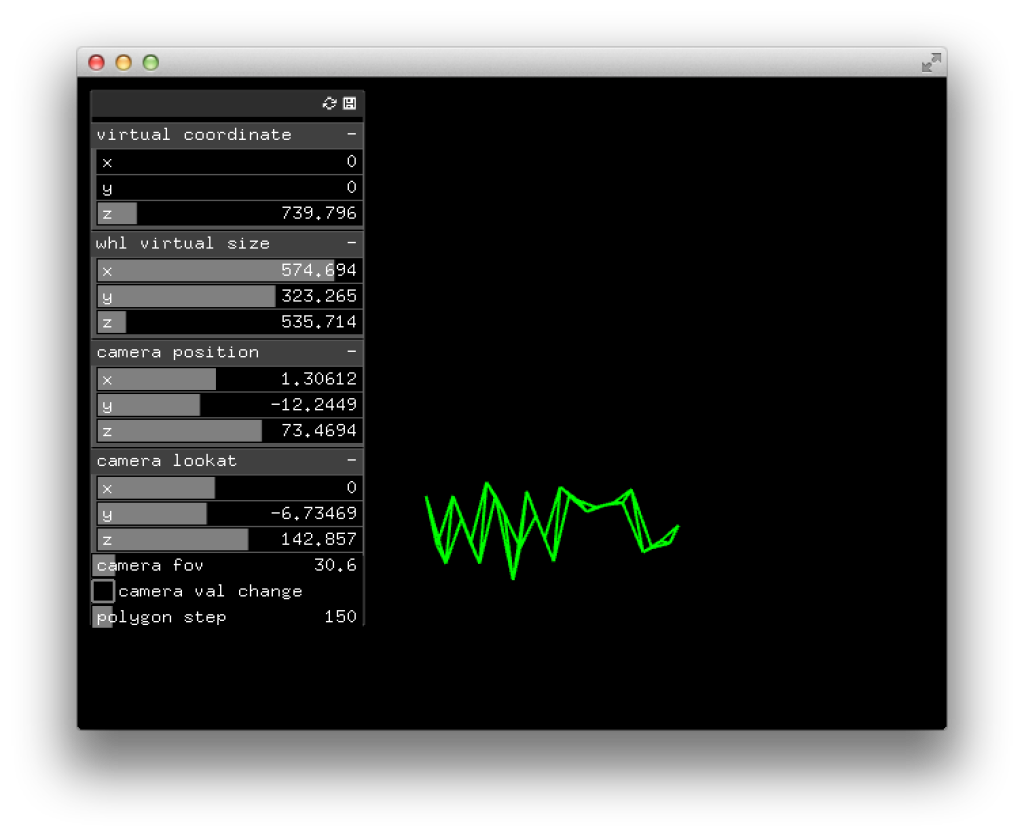

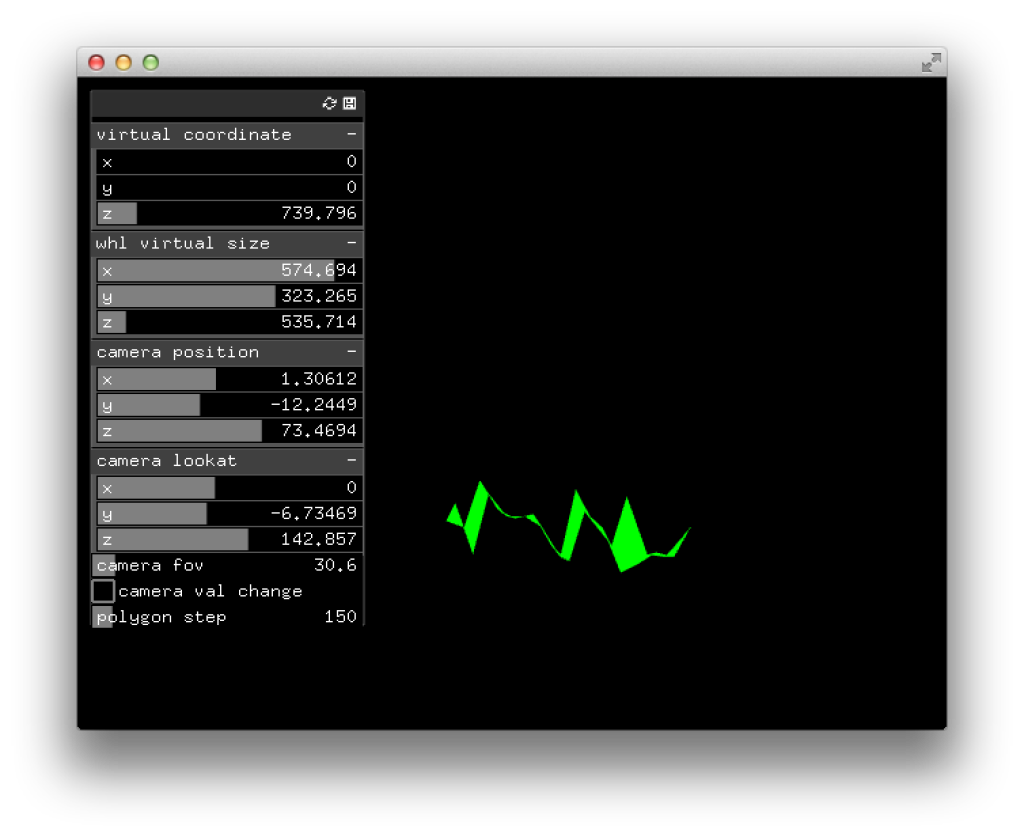

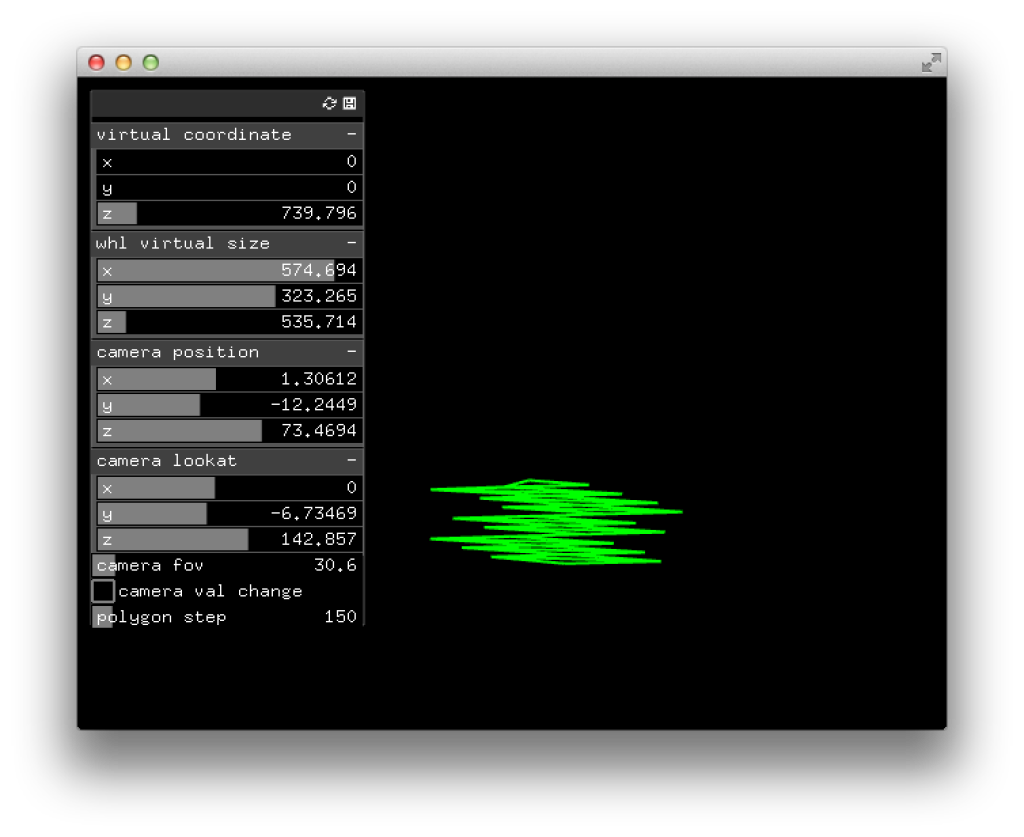

写真、動画を見てもらえればわかるとおり、Maker Faireのロゴ以外にパキパキ動く素材を投影したり。制御用の画面はこんな感じ。

この他に位置合わせ、表示の切り替えではVDMX5を利用。パキパキの動きのあるものは、depthとトラッキングしたdroneの表面をポリゴンステップ(左のメニュー)にあるステップに応じて作成して、投影面をポリゴン化している。こういう幾何的な模様を作って動きを出すときに便利。表示するものは、キーボードのキーで切り替えるようにして、動きに応じて投影する物を変えたり、パラメータの微調整とかを合間にしていた。

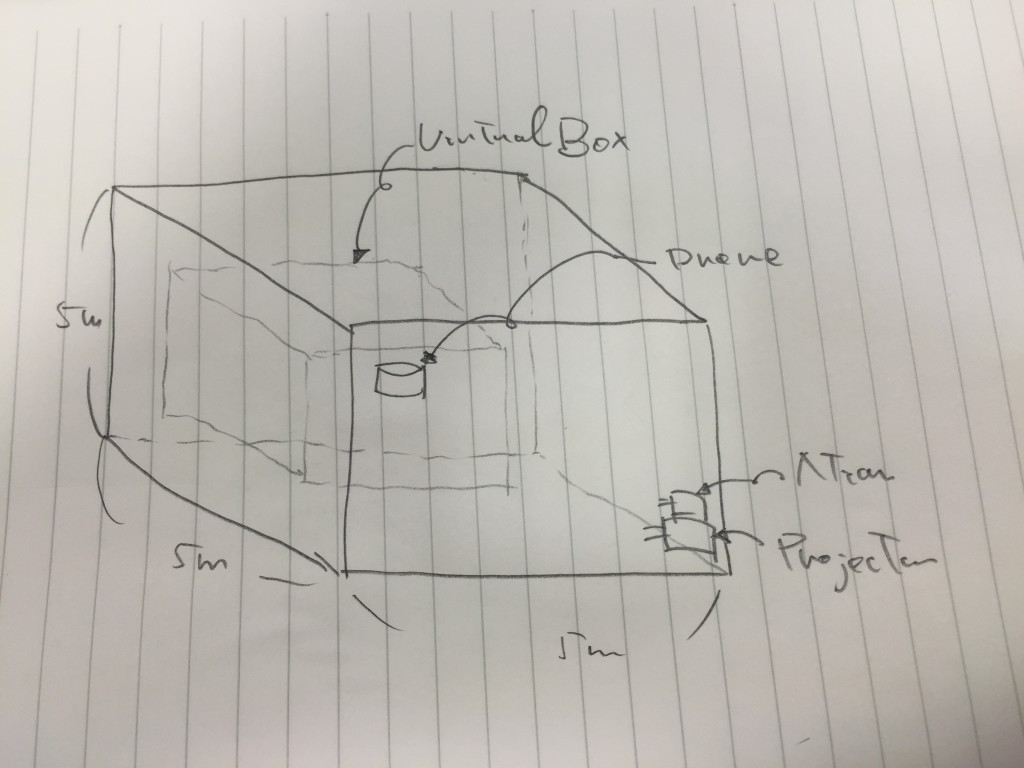

事前の構想メモはこんな絵で。仮想空間上のあるエリアに入ってきたら対象とみなして、投影をする感じ。

大抵のXtion/kinect物は、

1. 投影する先はあまり動かない。そして平面が多い(今回は3次元空間を動く)

2. 結果をディスプレイに写す場合がほとんどで、対象物に再フィードバック(投影)する事はあまりない。

この2点がちょっと今までとは違う感じ。再フィードバックがあるから、無駄な処理やロジックを単純化して、できるだけ追従できるようにしてみた(操作->droneの動き->トラッキング->処理->投影、この時間をできるだけ最小に)。

事前の実験だと、すげー光があたって綺麗に見えるはずだったのが、会場の環境だと青・赤がさっぱり見えなくなって、緑をベースにした物になった。暗い所だと、もっと色んな表現ができたんだけど、これは仕方なし。改善したい点はあって実験を重ねてみようかと。舞台で正面から見えるという状態だけなら前からだけでOKだけど、前後左右どこからでも見れる状態だとそうもいかないし。事前の実験はこんな感じ。

drone自体がプロジェクターを持ったり、LEDで光ったりするものは見た事があったけど、自由に投影できるとそれはそれで面白いと思われ。

直前にマウンタを作って搭載するという驚異の技を見せてくれた魔法の大鍋さんスゴス。この映像をOculus Rift DK2で見るということも。会場の様子が上から見渡せる映像が!!この映像、すごく良い。とっても良い感じ。

色々とdroneはセンシティブで飛ばせる環境も限られているけど、こういう面白い使い方、楽しみ方はいっぱいあると思う。